Die Forschungs- und Entwicklungsabteilung der BBC befindet sich inzwischen hauptsächlich in Manchester. Die imposante MediaCity wurde in den letzten Jahren auf dem Areal des früheren Binnenhafens hochgezogen – eine der Strukturhilfemaßnahmen, um der einst bedeutenden Industriestadt neue Perspektiven zu verschaffen. Inzwischen arbeiten bei BBC North 2.000 Menschen in den Abteilungen BBC 5Live, BBC Sport, BBC Breakfast BBC Childen’s und BBC R&D. Ganz in der Nähe hat auch die Universität Salford einen Standort. Die Nähe zur BBC sowie anderen Medien- und Technologiefirmen sollen Innovationen erleichtern. Dafür wurden vielfältige Kooperationen geschlossen. Seit 2 Jahren gibt es auch die BBC Audio Research Partnership mit der Uni Salford, sowie anderen englischen Universitäten und Firmen. Bei einem zweitägigen Treffen gab’s viele interessante Projekte, Ideen und neue Ansätze zu bestaunen…

(Sorry to my English readers – this is in German only. If you want to know more on this, check out the summary by Frank Melchior on the BBC R&D blog site)

Bemerkenswert ist, dass die Forschungs- und Entwicklungsaktivitäten bei BBC R&D einer Gesamtstrategie untergeordnet sind, die insgesamt ein „neues Rundfunksystem“ (a new broadcasting system) beschreiben, das sechs Eigenschaften haben soll:

• immersiv (virtualisierte Räumlichkeit)

• pervasiv (auf verschiedenen Plattformen)

• Daten angereichert (inhalts- und publikumsbezogenen)

• interaktiv (steuerbar)

• persönlich (individualisiert)

• adaptiv (anpassungsfähig)

Viel ist zur Zeit die Rede von 3DAudio. Damit sind all jene Technologien gemeint, mit denen ein Raumklangerlebnis vermittelt werden kann. Das ist zu einen Mehrkanalaudio von 5.1 – wie heute bei HDTV und im Digitalradio (DVB-S, DVB-C aber auch DAB+, wie z.B. auf BR-Klassik) quasi schon Standard – bis hin zu 22.2 Kanälen, wie das von NHK in Japan bei Ultra High Definition TV (auch UHDTV, Super Hi-Vision oder 8K genannt) verwendet wird.

Zum anderen aber auch binaurale Tonaufnahme (auch kopfbezogene Stereofonie oder HRTF). Früher hieß das in Deutschland einfach Kunstkopfstereofonie und wurde mit zwei Mikrofonen aufgenommen, die am Ende eines künstlichen Gehörgangs so eines Fantomas-Kopfes steckten. Auch das kann heute digital erzeugt werden (z.B. in Computerspielen) und wird dann als immersive audio bezeichnet (mehr zur Geschichte und Wiederbelebung der Kunstkopfstereofonie hier auf meinem Blog).

Beide Ansätze bedingen unterschiedliche Wiedergabesituationen: Mehrkanalaudio verlangt in seiner reinen Form mehrere Lautsprecher im Raum (allerdings gibt auch hier Virtualisierungstechniken, wie sie in Soundbars angewandt werden, die auf dem Prinzip der Wellenfeldsyntehse beruhen). Binaural hingegen braucht nur zwei Klangerzeuger – die dann dafür möglichst nah am Trommelfell positioniert werden müssen – idealerweise also Kopfhörer (aber auch hier erzeilt Digitaltechnik immer bessere Ergebnisse der „cross-talk cancellation“ bei Lautsprecherwiedergabe).

In der Praxis bedeutet das: Unterschiedliche Formate durch die Anzahl der Kanäle, unterschiedliche Verbreitungswege im Simulcast (5.1 Surround Sendungen werden gleichzeitig in optimierten Stereomischungen gesendet), nicht auf jedem Gerät und jeder Hörumgebung kann eine optimale Wiederzugabe erzeugt werden (Heimkinoanlage versus Smartphone) usw.

Der neue Ansatz der eine audio-objektbezogenen Produktion scheint für diese Schwierigkeiten Lösungen anzubieten: Klangereignissen werden räumliche Positionen als Metadaten mitgegeben – je nach Gerät und Abhörsituation werden die Klänge dann in den Raum hinein „berechnet“ (gerendert).

Letztes Jahr enstand als erste Produktion in dieser Technologie bei BBC Manchester in Zusammenarbeit der Hörspiel- und R&D-Abteilung das Hörspiel Pinocchio . Die Abmischung im Studio fand mit 24.2 Kanälen statt. Die Versionen für 5.1 (Podcast in Dolby Digital AC3 und MPEG Surround), binaural und 2.0 Stereo wurden daraus automatisch berechnet. Beim Workshop nun wurden Passagen in der 24.2 Originalmischung vorgeführt. (leider ist die Produktion nicht mehr auf der Webseite vorhanden).

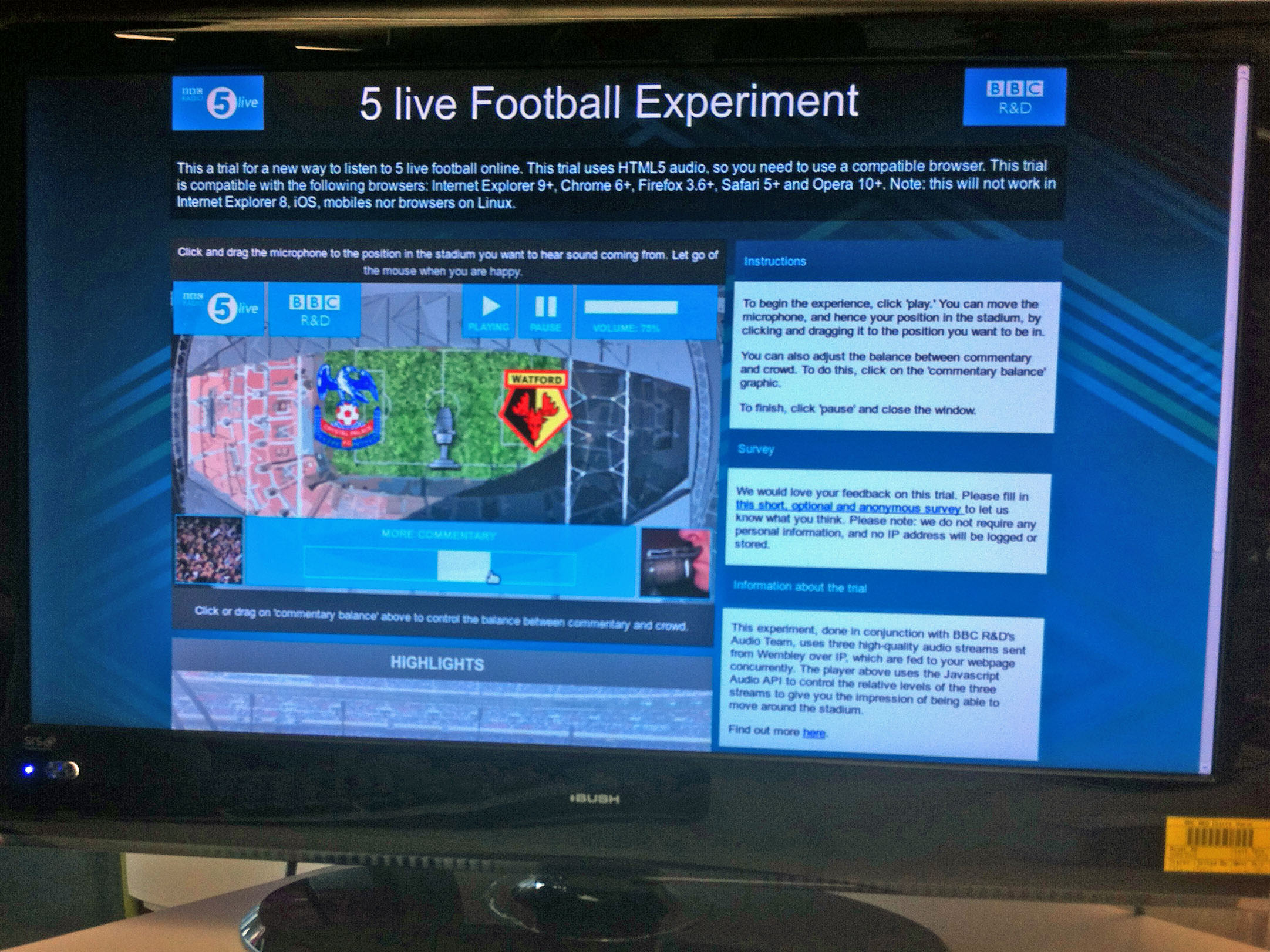

Ebenfalls mit Audio-Objekt-Technologie hat die BBC Sportredaktion eine Fussballreportage produziert, bei man nun nicht nur selbst entscheiden kann, wieviel Stadionatmo man hören will (wichtig z.B. für Schwerhörige) sondern auch, in welcher Fankurve man sitzen möchte.

Genauso funktioniert auch die Aufnahme eines Konzerts in der Londoner Royal Albert Hall, wo alljährlich im Sommer die berühmten PROMS stattfinden: Auch hier kann man via iPad sich eine bevorzugte Sitzposition aussuchen – sogar mitten drin im Orchester.

(Kopfhörer aufsetzen!)

Erste Tools für objekt-basierte Audioprouktion gibt es bereits auf dem Markt. Noch offen hingegen ist, in welchem Format solche Produktionen archiviert und reibungslos in den Workflow einer Rundfunkanstalt integriert werden können. Die notwendigen Standards sind hier noch nicht gesetzt. Auch die Distributionswege ist noch offen, geschweige denn die Implementierung in Empfangsgeräten – zumindest was den klassischen „Rundfunkverbreitungsweg“ (broadcast) betrifft. Via Internet hingegen lässt sich einiges bereits realisieren – was aber eben auch heisst, dass es so noch nicht massentauglich ist (fehlende Kapazitäten und Bandbreiten).

Tony Churnside vom BBC R&D Department hat diesen Paradigmenwechsel vom traditionellen hin zum objekt-orientierten Rundfunk auf dem R&D Blog anschaulich beschrieben und visualisiert.

Spannende neue Perspektiven zeichenen sich ab.

Pingback: Return of the Dummies - New appoach to head related stereo | bleisätze

Pingback: 40 Jahre Kunstkopfstereofonie – Vergangenheit mit Zukunft? | bleisätze